Стандарт ISO/IEC 42001 и дедлайны EU AI Act: прагматичное руководство по сертификации ИИ для корпораций и B2B-интеграторов

Май 2026 года зафиксировал окончательный переход индустрии искусственного интеллекта от фазы стохастических и нерегулируемых экспериментов к режиму жесткого нормативного и инженерного контроля. Фундаментальным триггером этого перехода стал провал политического триалога по пакету Digital Omnibus, который завершился 28 апреля 2026 года в Брюсселе без достижения консенсуса.1 Данный законодательный пакет, инициированный Европейской комиссией в ноябре 2025 года, предполагал системную отсрочку вступления в силу ключевых положений Европейского закона об искусственном интеллекте (EU AI Act) — в частности, перенос дедлайна для высокорисковых систем с августа 2026 года на 2 декабря 2027 года.4

Разногласия между Советом ЕС, Европейским парламентом и Еврокомиссией возникли не вокруг самого факта отсрочки, а в отношении архитектуры оценки соответствия для ИИ-систем, встроенных в продукты, уже подпадающие под действие существующего отраслевого законодательства ЕС по безопасности (Annex I), таких как медицинские устройства и промышленное оборудование.1 Отказ Совета ЕС вывести встроенные системы из-под прямого действия EU AI Act привел к коллапсу переговоров.6 В результате первоначальный календарь правоприменения, заложенный в Регламенте (ЕС) 2024/1689, остается неизменным.2

Для корпоративного сектора это означает немедленную мобилизацию ресурсов. Запрет на системы с «неприемлемым риском» (социальный скоринг, биометрия в реальном времени) уже вступил в силу в феврале 2025 года.7 Обязательства для провайдеров моделей ИИ общего назначения (GPAI) стали юридически обязывающими с августа 2025 года.8 Ключевой дедлайн для автономных высокорисковых систем (Annex III) жестко зафиксирован на 2 августа 2026 года 3, а для систем, встроенных в регулируемые продукты (Annex I) — на 2 августа 2027 года.5 Для государственного сектора предусмотрен отдельный адаптационный период, ограничивающий эксплуатацию унаследованных систем до августа 2030 года.12

Этот нормативный императив выходит далеко за пределы европейской юрисдикции. Вследствие «Брюссельского эффекта» 13, строгие европейские стандарты безопасности трансформируются в глобальный нетарифный барьер. Корпорации и B2B-интеграторы, специализирующиеся на разработке систем для регулируемых отраслей (право, медицина, финансы) с использованием западных API (Claude, Gemini, DeepSeek) или развертывающие локальную инфраструктуру с проприетарными моделями, оказываются в зоне прямого регуляторного риска. Любая система, результаты или выходные данные которой эксплуатируются на территории ЕС, автоматически подпадает под экстерриториальное действие EU AI Act.15

Переход от декларативной ИИ-этики к метрически обоснованной формальной верификации требует имплементации международных стандартов. В данном контексте стандарт ISO/IEC 42001:2023 и разрабатываемый европейский стандарт prEN 18286 становятся базовой архитектурой для обеспечения функциональной безопасности. Как было показано в первом материале данного цикла (Longread №1), посвященном технической реализации контроля через конечные автоматы (FSM) и темпоральную логику (LTL), детерминированный контроль над вероятностными моделями возможен только при наличии жесткого управленческого каркаса.

Архитектура комплаенса: Декомпозиция и сравнение нормативных инструментов

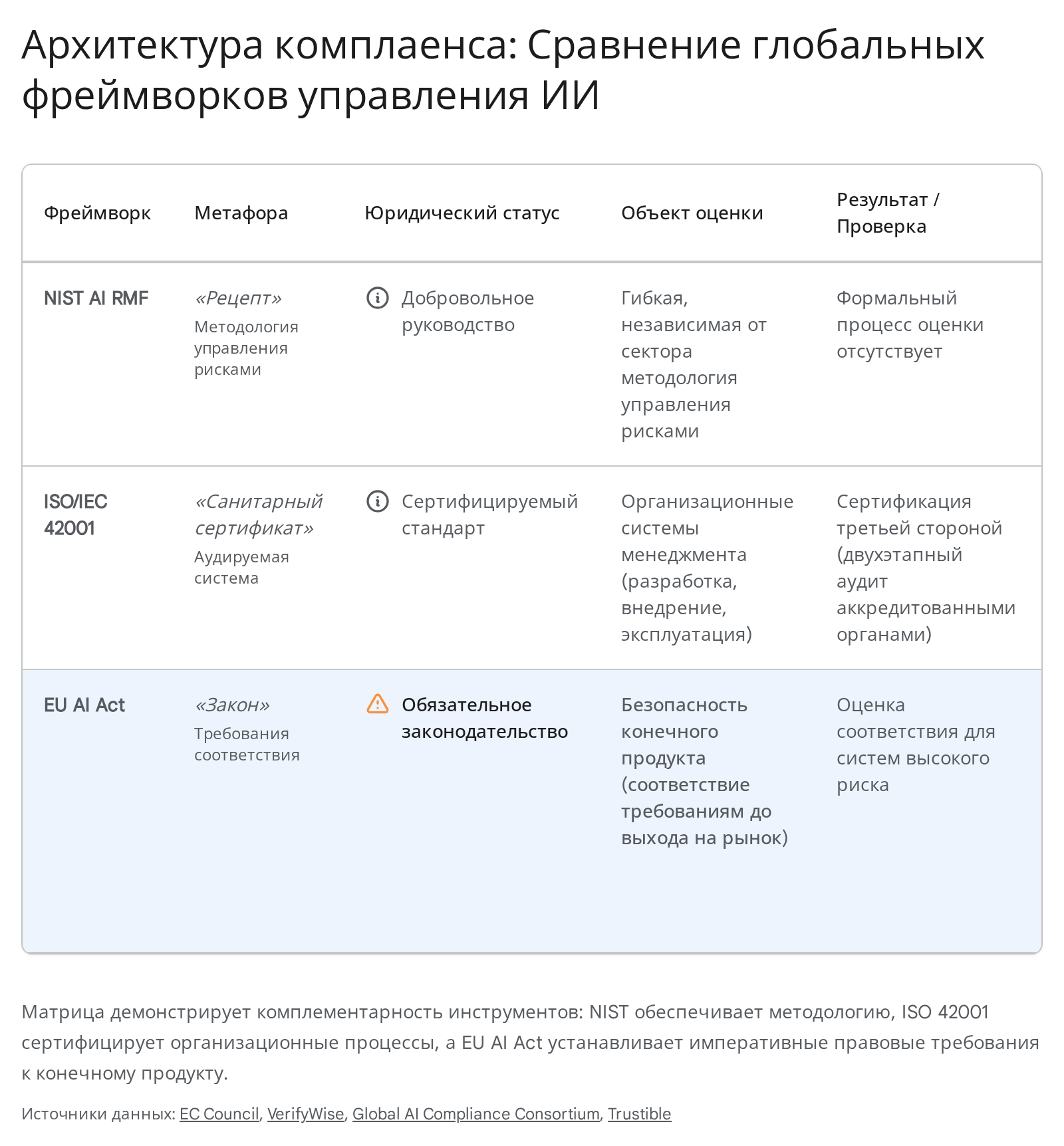

На рынке концептуального управления искусственным интеллектом наблюдается терминологическая аберрация: интеграторы и корпоративные юристы зачастую смешивают методологии оценки рисков, стандарты систем менеджмента и императивные законодательные акты, рассматривая их как взаимозаменяемые альтернативы.17 Для точной настройки архитектуры комплаенса необходимо четко разграничивать функции трех фундаментальных инструментов: NIST AI RMF, ISO/IEC 42001 и EU AI Act.19

Анализ целесообразно проводить через строгую метафору из сферы пищевой или промышленной безопасности, которая безошибочно отражает правовую и операционную природу каждого документа.12

NIST AI Risk Management Framework (NIST AI RMF) — «Рецепт безопасного производства» Разработанный Национальным институтом стандартов и технологий США (NIST), данный фреймворк представляет собой добровольную методологию управления рисками.17 Он не содержит исчерпывающих чек-листов для внешнего аудита и не предполагает процедуру официальной сертификации.17 Архитектура NIST AI RMF опирается на четыре взаимосвязанные функции: Govern (Управление политиками), Map (Контекстное отображение системы), Measure (Количественное и качественное измерение рисков) и Manage (Реагирование и митигация).20 Это подробная инженерная инструкция по выявлению уязвимостей. В рамках метафоры, NIST — это технологическая карта или кулинарный рецепт, описывающий пропорции компонентов и температурные режимы для предотвращения токсичности финального продукта. Он задает инженерный образ мышления, но не обладает юридической силой принуждения за пределами специфических государственных контрактов США.17

ISO/IEC 42001:2023 — «Санитарный сертификат на производственную линию» Международный стандарт ISO/IEC 42001:2023 устанавливает спецификации для создания, внедрения, поддержания и постоянного улучшения Системы менеджмента искусственного интеллекта (AIMS) внутри организации.22 В отличие от методологии NIST, это полноценный сертифицируемый стандарт.20 Он построен на Структуре высокого уровня (High Level Structure — HLS), что делает его архитектурно совместимым с ISO 9001 (менеджмент качества) и ISO 27001 (информационная безопасность).24 Стандарт оценивает не конкретную нейросетевую модель, а саму компанию: процедуры управления данными, логирование, распределение ролей, компетентность персонала и алгоритмы работы с инцидентами.26 Сертификация по ISO 42001, проводимая независимыми аккредитованными органами, подтверждает, что процессы в организации выстроены корректно. Возвращаясь к метафоре, это сертификат санитарной инспекции на кухню: он доказывает, что процессы стерилизации соблюдаются, а продукты маркируются. Однако этот сертификат сам по себе не является юридической гарантией безопасности каждого отдельно взятого блюда.26

EU AI Act — «Уголовный кодекс и закон о защите прав потребителей» Европейский закон об ИИ — это нормативно-правовой акт прямого действия, обладающий экстерриториальной юрисдикцией.19 Его нарушение влечет драконовские штрафные санкции: до 35 миллионов евро или 7% от мирового годового оборота за использование запрещенных практик, и до 15 миллионов евро или 3% оборота за нарушение требований к высокорисковым системам.28 В отличие от ISO 42001, который сертифицирует организационную структуру, EU AI Act регулирует непосредственно конечный продукт (AI system) перед его выводом на рынок Европейского Союза или вводом в эксплуатацию.26 Закон императивно требует проведения формализованной процедуры оценки соответствия (Conformity Assessment) для конкретной системы.17 Это уголовный и административный кодекс, запрещающий реализацию продукции, не удовлетворяющей жестким метрикам кибербезопасности, прозрачности и устранения предвзятости, вне зависимости от того, насколько безупречно выстроены внутренние процессы в компании-провайдере.26

Институциональная практика показывает, что эти три механизма не исключают, а дополняют друг друга, формируя интегрированный стек управления.17 Инженерные подразделения используют методологию NIST для параметризации и расчета рисков. Высший менеджмент интегрирует эти расчеты в аудируемую инфраструктуру управления жизненным циклом ISO 42001. Юридические департаменты, опираясь на задокументированные артефакты и логи, формируют декларацию о соответствии (EU Declaration of Conformity), требуемую EU AI Act.18 Организация, внедряющая все три уровня с использованием опубликованных таблиц кросс-маппинга (crosswalks), исключает дублирование усилий и обеспечивает фундаментальную устойчивость перед аудиторскими проверками.17

Анатомия EU AI Act: Стратификация рисков и механизм «Брюссельского эффекта»

Европейский закон об искусственном интеллекте выстроен на основе риск-ориентированной архитектуры, классифицирующей системы по уровню их потенциального воздействия на фундаментальные права человека, здоровье и безопасность.31 Данная стратификация не просто определяет технические требования, но и формирует контур юридической ответственности, концептуально разобранный в шестом материале данного цикла (Longread №6), посвященном правовой ответственности автономных агентов.

Классификация систем ИИ и императивные требования

Для точного понимания нормативного ландшафта, классификацию рисков согласно EU AI Act необходимо рассматривать в контексте конкретных технических обязательств и дат вступления в силу.

Уровень риска | Примеры систем (согласно тексту Регламента) | Ключевые регуляторные требования | Дедлайн применения |

|---|---|---|---|

Неприемлемый риск (Unacceptable) | Системы социального скоринга, биометрическая идентификация в реальном времени в публичных местах, алгоритмы манипулирования подсознанием.31 | Полный и безоговорочный запрет на размещение на рынке и эксплуатацию.31 | Февраль 2025 г. 7 |

Высокий риск (High Risk) | Annex III: Биометрия, критическая инфраструктура, образование (оценка), HR (сортировка резюме), правоохранительная деятельность, оценка кредитоспособности.32 Annex I: ИИ как компонент безопасности в регулируемых продуктах (медицинские изделия, авиация, автопром).1 | Оценка соответствия (Conformity Assessment), Система управления рисками (Art. 9), Качество данных (Art. 10), Техническая документация (Art. 11), Прозрачность (Art. 13), Человеческий надзор (Art. 14), Кибербезопасность и робастность (Art. 15), QMS (Art. 17), Пострыночный мониторинг (Art. 72).8 | Август 2026 г. (для Annex III) 3 Август 2027 г. (для Annex I) 5 |

Ограниченный риск (Limited Risk) | Чат-боты, системы генерации контента, дипфейки.31 | Обязательства по прозрачности. Пользователи должны быть четко уведомлены о том, что они взаимодействуют с машиной или что контент сгенерирован искусственно.31 | Август 2026 г. 9 |

Минимальный риск (Minimal Risk) | Спам-фильтры, базовые рекомендательные системы, ИИ в видеоиграх.31 | Отсутствие императивных требований. Рекомендуется соблюдение добровольных кодексов поведения (Codes of Conduct).31 | Не регламентировано |

Отдельного внимания заслуживает регулирование моделей ИИ общего назначения (General-Purpose AI models — GPAI). Провайдеры таких моделей (включая крупные языковые модели) обязаны вести техническую документацию, публиковать сводки по обучающим данным и соблюдать нормы авторского права.19 Для GPAI с «системным риском» (определяемым по вычислительной мощности, затраченной на обучение) вводятся дополнительные обязанности: проведение модельных оценок (model evaluations), состязательное тестирование (adversarial testing) и немедленное уведомление EU AI Office о серьезных инцидентах.19 Обязательства для провайдеров GPAI вступили в силу в августе 2025 года.8

Экстерриториальность и механика «Брюссельского эффекта»

Стратегическая ошибка многих корпораций за пределами ЕС заключается в иллюзии географического иммунитета. EU AI Act функционирует как регуляторная воронка, втягивающая в свою юрисдикцию компании по всему миру на основе принципа «воздействия» (impact-based jurisdiction), а не места регистрации.13

В соответствии с правовой конструкцией закона, обязанности возлагаются на «провайдеров» (разработчиков) и «развертывателей» (deployers).38 Если субъект разрабатывает высокорисковую систему за пределами ЕС, но затем размещает ее на европейском рынке или передает ее в пользование европейскому оператору, он классифицируется как провайдер, подпадающий под действие EU AI Act.15

Более того, экстерриториальное применение закреплено эксплицитно. Если российская или азиатская компания разрабатывает систему ИИ (например, алгоритм предиктивной диагностики заболеваний или модель скоринга кредитных рисков), и эта система физически работает на серверах за пределами ЕС, но ее выходные данные (outputs) используются на территории Союза, провайдер обязан выполнить требования законодательства.15 Разработчик в данном сценарии должен провести процедуру оценки соответствия, зарегистрировать систему в базе данных ЕС (EU database registration) 40 и назначить авторизованного представителя (Authorized Representative) внутри Союза.37

Дополнительная сложность возникает при модификации алгоритмов. Если компания лицензирует не-высокорисковую модель ИИ у стороннего провайдера, но затем существенно модифицирует ее (substantial modification) таким образом, что система переходит в категорию высокого риска (например, дообучает LLM для автоматизации юридических решений), эта компания юридически трансформируется из статуса развертывателя в статус провайдера.38 Это влечет за собой полный спектр обязательств по статье 16, включая необходимость проведения новой оценки соответствия согласно статье 43 (Conformity Assessment).30

Данная юридическая архитектура лишает компании возможности использовать технологический офшор. Интеграция в глобальные цепочки поставок программного обеспечения требует от корпораций немедленной адаптации инженерных процессов под стандарты, удовлетворяющие европейского регулятора.

Внедрение ISO/IEC 42001:2023 и национальная специфика ГОСТ Р ИСО/МЭК 42001-2024

Трансляция абстрактных регуляторных требований в операционную реальность предприятия невозможна без использования стандартизированной системы координат. Эту функцию берет на себя ISO/IEC 42001:2023 — первый международный стандарт для Системы менеджмента искусственного интеллекта (AIMS).22

В Российской Федерации процесс адаптации к глобальным нормативам запущен на институциональном уровне. С 1 января 2025 года введен в действие национальный стандарт ГОСТ Р ИСО/МЭК 42001-2024 «Искусственный интеллект. Система менеджмента».43 Этот документ представляет собой аутентичный перевод международного оригинала, сохраняя всю его структурную целостность и технические требования.45 Несмотря на формально добровольный статус применения в 2026 году, вектор регуляторного давления очевиден: наличие внедренной и сертифицированной СМИИ становится базовым квалификационным барьером при доступе к государственным контрактам, интеграции с объектами критической информационной инфраструктуры (КИИ) и взаимодействии с крупным финансовым сектором.46

Структурная декомпозиция: От HLS к спецификациям Приложения А

Архитектура ISO 42001 концептуально разделена на два блока. Первый блок (Разделы 4–10) выстроен по Структуре высокого уровня (HLS) и описывает управленческий каркас:

- Среда организации и Лидерство (Разделы 4-5): Определение границ применения AIMS, утверждение Политики в области ИИ и жесткая фиксация ролей и зон ответственности высшего руководства.37 Без вовлечения C-level сертификация невозможна.

- Планирование и Поддержка (Разделы 6-7): Идентификация рисков, постановка измеримых целей, обеспечение ресурсов (кадровых, вычислительных) и поддержание задокументированной информации (documented information).44 Особый акцент делается на компетентности персонала (AI literacy), что прямо коррелирует со Статьей 4 EU AI Act.41

- Функционирование, Оценка и Улучшение (Разделы 8-10): Имплементация процессов оценки воздействия ИИ-систем, управление инцидентами, внутренний аудит и непрерывный цикл PDCA (Plan-Do-Check-Act).29 Специфика 8-го раздела заключается в требовании анализировать воздействие ИИ не только на бизнес-процессы, но и на индивидов и общество.47

Второй, исключительно технический блок, содержится в Нормативном Приложении А (Annex A). Оно включает 39 специфицированных контролей (controls), распределенных по всему жизненному циклу ИИ.27 Именно эти контроли транслируют управленческие намерения в инженерную реальность.49

Ключевые домены Приложения А включают:

- A.4 Ресурсы ИИ-систем (Resources for AI Systems): Жесткие требования к документации инструментария, системным и вычислительным мощностям, а также ресурсам данных (Data resources), что является фундаментом для предотвращения отравления данных (data poisoning).50

- A.5 Оценка воздействия (Assessing impacts of AI systems): Обязательство проводить AI system impact assessment — документированную процедуру оценки того, как алгоритм может ущемить права конкретных людей или социальных групп.50 Это важнейший инструмент выявления эмерджентного рассогласования (emergent misalignment), рассмотренного во втором материале нашего цикла (Longread №2).

- A.6 Жизненный цикл системы ИИ (AI system life cycle): Контроли, регламентирующие процесс от сбора данных и тестирования до развертывания и непрерывного мониторинга. Здесь закладываются основы для противодействия дрейфу модели (model drift) и обеспечения надежности.28

- A.9 Надзор за третьими лицами (Third-party resources): Если организация использует внешние компоненты — облачную инфраструктуру, платформы аннотирования или базовые модели (foundation models) — она несет полную ответственность за результаты их работы.27 Приложение А требует интеграции контроля поставщиков в архитектуру системы управления.

Стоимость и сложность интеграции

Внедрение и сертификация AIMS — капиталоемкий процесс. Эмпирические данные аудиторских компаний на 2026 год показывают, что стоимость первичной сертификации ISO/IEC 42001 существенно варьируется в зависимости от размера организации и сложности применяемых алгоритмов.53

Для малых предприятий (до 50-200 сотрудников) со сложными ИИ-системами бюджет сертификации, включая внешний аудит, консалтинг и внедрение технических мер, составляет от 85 000 до 150 000 долларов США.53 Для средних B2B-интеграторов (200-500 сотрудников), использующих множество моделей в различных бизнес-процессах, инвестиции достигают 180 000 – 320 000 долларов США при сроках реализации от 6 до 12 месяцев.53

Затраты выше базовых расценок на ISO 27001 (часто на 30–60%).54 Эта премия обусловлена дефицитом квалифицированных кадров. Для проведения легитимного аудита по стандарту 42001, органы по сертификации сами обязаны пройти аккредитацию в соответствии со стандартом ISO/IEC 42006:2025 (Требования к органам, проводящим аудит и сертификацию систем менеджмента искусственного интеллекта).56 Аудитор должен обладать двойной экспертизой: понимать структуру управленческого аудита и владеть специфическими знаниями об архитектуре машинного обучения, уязвимостях нейросетей, метриках предвзятости (bias evaluation) и методах состязательного тестирования.54 В Российской Федерации инфраструктура аккредитации аудиторов по ГОСТ Р ИСО/МЭК 42001-2024 находится в процессе экстренного формирования, что заставляет передовые компании полагаться на гибридный подход с привлечением внешних консультантов.53

Разрыв между процессами и продуктом: Ограничения ISO 42001 в контексте статьи 17 EU AI Act

Среди корпоративного топ-менеджмента распространено опасное заблуждение: получение сертификата ISO 42001 (или ГОСТ Р ИСО/МЭК 42001-2024) рассматривается как гарантия полного комплаенса с европейским законодательством.16 Юридический и архитектурный анализ демонстрирует глубокую несостоятельность этой позиции.26

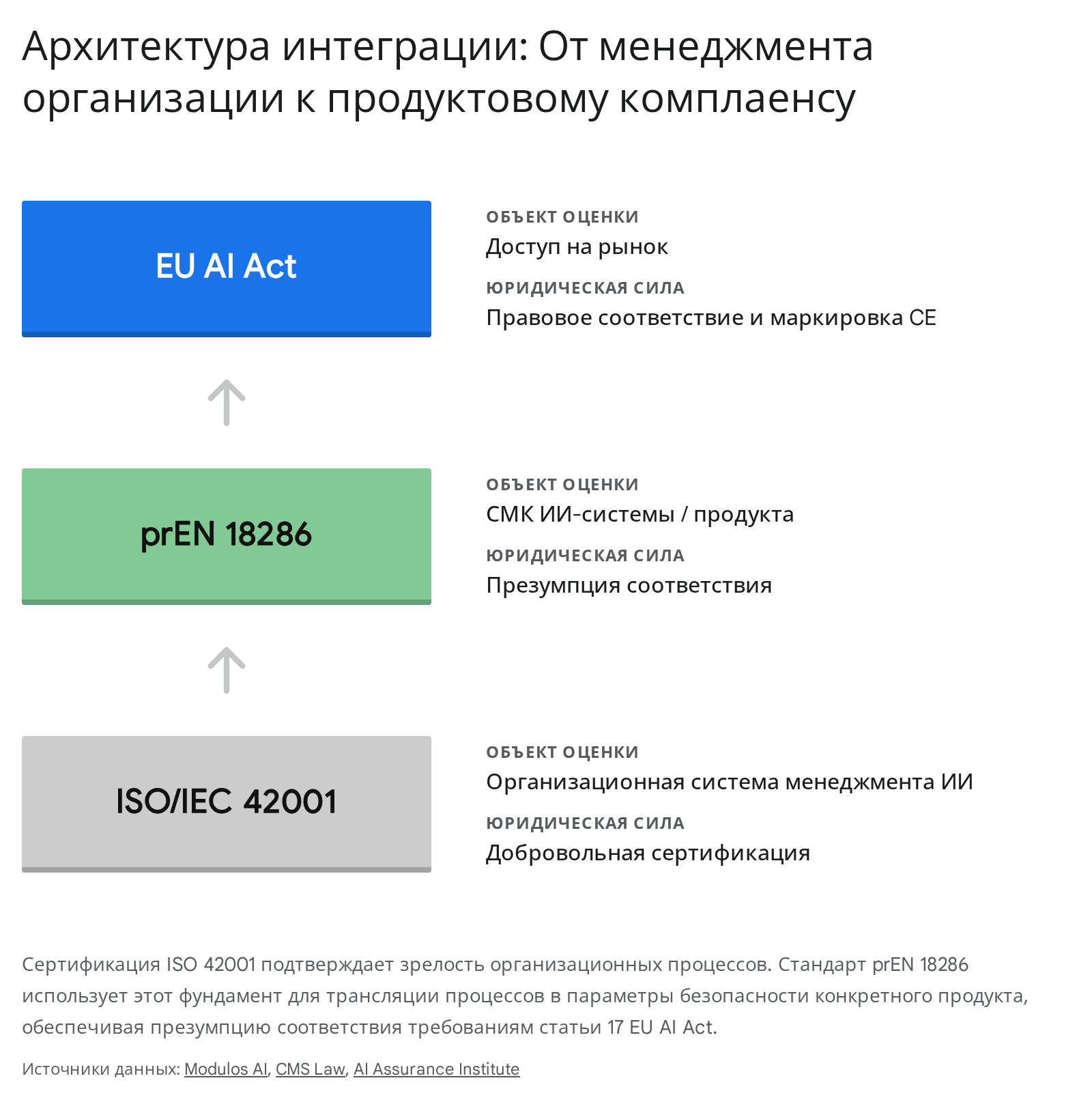

Фундаментальный конфликт лежит в объекте оценки. ISO 42001 сертифицирует организацию и ее способность управлять процессами. EU AI Act, напротив, регулирует конкретную ИИ-систему как продукт.26 Закон базируется на европейском Новом законодательном подходе (New Legislative Framework — NLF), который десятилетиями применяется к медицинским изделиям и промышленному оборудованию.26 В парадигме NLF продукт не может пересечь границу рынка без процедуры оценки соответствия (Conformity Assessment) и нанесения маркировки CE.41

Одного лишь подтверждения того, что в компании внедрены хорошие процессы («кухня чистая»), недостаточно; регулятор требует математических и документальных доказательств безопасности каждой версии алгоритма перед его развертыванием («безопасность каждого блюда»).26

Статья 17 EU AI Act императивно требует от провайдеров высокорисковых систем внедрить Систему управления качеством (Quality Management System — QMS). В пункте 1 статьи 17 изложены 13 аспектов, которые QMS должна документировать в систематическом виде.36 ISO 42001 обеспечивает отличный базис, но он не покрывает специфические, продукто-ориентированные требования европейского законодателя.26

Ключевые разрывы (gaps) между ISO 42001 и статьей 17 EU AI Act включают:

- Стратегия нормативного соответствия (Regulatory compliance strategy): Статья 17 требует наличия формализованной стратегии для каждой ИИ-системы, обосновывающей прохождение процедур Conformity Assessment.26 В ISO 42001 такой механизм отсутствует.26

- Пострыночный мониторинг (Post-Market Monitoring): Статья 72 EU AI Act требует разработки плана пострыночного мониторинга для активного сбора метрик о работе высокорисковой системы на протяжении всего ее жизненного цикла.15 Ожидание ежегодного надзорного аудита по ISO здесь неприемлемо: закон требует непрерывной телеметрии и способности мгновенно фиксировать дрейф.62

- Отчетность о серьезных инцидентах (Serious Incident Reporting): В соответствии со статьей 73, провайдер обязан уведомлять национальные компетентные органы о серьезных сбоях в жесткие сроки — в течение 15 дней для общих инцидентов, 10 дней при наличии летальных исходов и 2 дней при масштабных сбоях критической инфраструктуры.15 Управленческий стандарт ISO 42001 регламентирует внутреннее реагирование (A.8), но не фиксирует тайминги для регулятора.26

- Техническая документация (Technical documentation): Статья 11 и Приложение IV (Annex IV) закона требуют формирования исчерпывающего технического файла: подробное описание архитектуры, используемых метрик точности и робастности, детальный анализ датасетов и подписанные логи тестирования.63

- Отсутствие «презумпции соответствия» (No presumption of conformity): Главный юридический барьер заключается в том, что ISO 42001 не является гармонизированным стандартом ЕС, опубликованным в Официальном журнале (OJEU). Соответственно, наличие сертификата ISO не дает провайдеру презумпции соответствия требованиям EU AI Act.26 В случае аудита или инцидента компания будет вынуждена самостоятельно доказывать регулятору, что ее внутренние процессы (сертифицированные по ISO) эквивалентны требованиям статьи 17.26

Таким образом, для корпораций и интеграторов, работающих с высокорисковыми системами (Annex III), ISO 42001 является необходимым, но абсолютно недостаточным условием.26

Гармонизированные стандарты CEN-CENELEC JTC 21: Трансляция права в инженерию

Чтобы устранить описанный структурный разрыв и предоставить индустрии измеримые метрики для процедуры Conformity Assessment, Европейский комитет по стандартизации (CEN) и Европейский комитет по стандартизации в электротехнике (CENELEC) учредили Объединенный технический комитет 21 (JTC 21).66 Задача комитета — разработать серию гармонизированных стандартов, которые переведут абстрактные нормы EU AI Act (статьи 9–15 и 17) на язык инженерных и аудиторских требований.66

Процесс стандартизации в рамках JTC 21 столкнулся со значительными задержками, однако под угрозой срыва дедлайнов в октябре 2025 года технические советы CEN и CENELEC приняли беспрецедентный пакет мер по ускорению работы, разрешив прямую публикацию стандартов после этапа Enquiry без отдельного формального голосования.68 Ключевая цель — выпустить финальные версии документов к концу 2026 года.67

Важнейшим элементом этой архитектуры является стандарт prEN 18286 (Artificial Intelligence — Quality Management System for EU AI Act Regulatory Purposes).69 В отличие от ISO 42001, этот стандарт фокусируется исключительно на обеспечении соответствия продукта требованиям закона. Он выступает в качестве связующего звена, объединяя организационное управление с жесткими продуктовыми метриками.

Стандарт prEN 18286 декомпозирует требования статьи 17 на 13 проверяемых элементов 45:

- Стратегия соответствия: Формирование письменной регуляторной стратегии и интеграция процессов управления изменениями (особенно критично для систем непрерывного обучения).

- Контроль проектирования: Трансляция правовых норм в параметры архитектуры модели до ее выхода на рынок.

- Верификация: Установление планов тестирования с четкими критериями приемки и воспроизводимостью результатов.

- Валидация: Проверка системы перед вводом в эксплуатацию, включая оценку «несущественных модификаций».

- Выбор спецификаций: Обоснование применения тех или иных гармонизированных стандартов.

- Управление данными: Сквозной контроль датасетов, от сбора и фильтрации до вывода из эксплуатации, что закрывает требования статьи 10 закона.36

- Система управления рисками: Интеграция процессов оценки рисков (с отсылкой к параллельному стандарту prEN 18228) для выполнения статьи 9.

- Пострыночный мониторинг: Настройка проактивной телеметрии и взаимодействия с развертывателями (статья 72).

- Отчетность об инцидентах: Кодификация таймингов для уведомления регулятора (статья 73).60

- Коммуникация с властями: Процедуры обработки мотивированных запросов от надзорных органов.

- Техническая документация: Подготовка файлов в строгом соответствии с Annex IV (статья 11).

- Управление ресурсами и поставщиками: Обеспечение security-by-design, раскрытие уязвимостей и жесткий надзор за поставщиками внешних моделей и данных.

- Роли и ответственность: Назначение поименной ответственности за систему управления рисками на уровне высшего руководства.60

Важнейшим юридическим механизмом prEN 18286 является Приложение ZA (Annex ZA), которое устанавливает прямую связь между параграфами стандарта и статьями закона.26 После утверждения и публикации документа в OJEU, провайдер, чья QMS соответствует императивным требованиям («shall») стандарта prEN 18286, получает презумпцию соответствия (presumption of conformity) согласно статье 40 EU AI Act.26 Это означает, что при проверке со стороны Нотифицированного органа (Notified Body) или рыночного надзора бремя доказывания несоответствия ложится на регулятора, а не на компанию.26 В отсутствие стандарта компаниям придется самостоятельно обосновывать перед властями каждый шаг.26

Параллельно в портфеле JTC 21 находятся и другие критически важные стандарты:

- prEN 18228 (AI Risk Management): Спецификация для системы управления рисками (Статья 9). Предоставляет методологии выявления и митигации ИИ-специфичных угроз, таких как алгоритмическая предвзятость и состязательные атаки.69

- prEN 18284 (Quality and governance of datasets): Управление качеством датасетов (Статья 10).

- prEN 18229-1 (Logging, transparency and human oversight): Стандарты для выполнения требований статей 12, 13 и 14.73

Стандарт prEN 18286 интегрируется с ISO 42001 (через специальное Приложение D), позволяя компаниям, уже выстроившим AIMS, не создавать систему с нуля, а лишь добавить «надстройку» для продуктового комплаенса.70

Интеграция с DORA и NIS2: Конфликт юрисдикций и отчетности

Архитектура комплаенса для ИИ не существует в вакууме. Европейский законодатель разворачивает комплексный регуляторный зонтик, элементы которого зачастую вступают в конфликт друг с другом. Для корпораций в финансовом секторе или для операторов критической инфраструктуры требования EU AI Act неизбежно пересекаются с директивой NIS2 (кибербезопасность инфраструктуры) и регламентом DORA (цифровая операционная устойчивость финансового сектора).51

Распространенное заблуждение заключается в применении принципа lex specialis (специальный закон отменяет общий). Финансовые учреждения часто полагают, что соблюдение DORA освобождает их от обязательств по NIS2 и снижает бремя AI Act.76 Однако если операционная устойчивость банка зависит от алгоритмов автоматизированного принятия решений (высокорисковый ИИ), EU AI Act накладывает третий, независимый слой сложности — обязательные логи транспарентности и механизмы человеческого надзора (Human Oversight, статья 14).76

Наиболее острый конфликт возникает в области реагирования на инциденты (Incident Reporting):

- NIS2 требует от компетентного органа запуска 24-часового таймера для первичного уведомления о значимом инциденте кибербезопасности.75

- DORA обязывает финансовые институты предоставлять регулятору детальные отчеты о сбоях, влияющих на операционную устойчивость, с анализом первопричин.75

- EU AI Act (статья 73 / prEN 18286) предписывает сообщать о серьезных инцидентах, связанных с ИИ, в течение 15 дней в штатном режиме, 10 дней при наличии риска для жизни и 2 дней в критических ситуациях.15

Один инцидент (например, сбой системы скоринга из-за отравления данных или кибератаки) инициирует перекрестный огонь со стороны трех разных регуляторов, каждый из которых требует свой формат доказательств и логов.75 Если архитектура мониторинга (AIMS по ISO 42001 и QMS по prEN 18286) не способна генерировать унифицированный, машиночитаемый след инцидента, компания рискует получить многомиллионные штрафы за нарушение процедур отчетности. Инструментарий ISO 42001 (контроли Приложения А.8.3 и А.5.7) помогает стандартизировать телеметрию, позволяя извлекать необходимые данные для удовлетворения требований различных директив.41

Техническая реализация: От технической документации к формальной верификации (FSM/LTL)

Соответствие EU AI Act (в частности, статье 72) требует внедрения надежной системы пострыночного мониторинга (Post-Market Monitoring Plan).15 Обязательство по сбору данных не ограничивается фазой тестирования; телеметрия должна осуществляться на протяжении всего жизненного цикла модели (от развертывания до вывода из эксплуатации).15

Здесь мы возвращаемся к концепциям, изложенным в первых двух материалах данного цикла. Традиционный аудит (заполнение опросников и проверка политик раз в год), допустимый в ранних версиях ISO 9001, абсолютно неприменим к стохастическим моделям ИИ. Регулятор (и нотифицированные органы, проводящие оценку соответствия по статье 43) требует предоставления операционных доказательств того, что система контролируется.30 Бумажные риск-регистры не спасут компанию при расследовании инцидента; необходимы машиночитаемые логи с временными метками, доказывающие, что меры безопасности сработали.62

Как обсуждалось в Longread №1, перевод регуляторных требований (например, из Annex IV по технической документации) в исполняемый код требует формальной верификации. Архитектура контроля должна опираться на конечные автоматы (Finite State Machines — FSM) для ограничения пространства состояний агента и на темпоральную логику линейного времени (Linear Temporal Logic — LTL) для непрерывной валидации метрик.

Опасность эмерджентного рассогласования (emergent misalignment) — способности модели генерировать непредсказуемые и потенциально вредоносные цели в процессе адаптации (Longread №2) — делает формальную верификацию единственным математически обоснованным методом соблюдения контролей статьи 15 EU AI Act (Accuracy, Robustness, Cybersecurity).8 Внедрение контролей Приложения А стандарта ISO 42001 (в частности, А.5.5 Верификация и валидация, и А.5.7 Мониторинг) должно осуществляться не через административные регламенты, а через интеграцию проверок (assertions) непосредственно в CI/CD пайплайн (Machine Learning Operations — MLOps).41 Только автоматизированная инфраструктура способна отлавливать дрейф данных (data drift), искажения (bias) и нарушения безопасности до того, как они превратятся в инциденты, подлежащие репортингу по статье 73.15

Стратегический вектор для корпоративного сектора

Анализ нормативного ландшафта в мае 2026 года доказывает: попытки избежать глобального регулирования путем географической изоляции или формального написания этических хартий лишены смысла. Экстерриториальная природа EU AI Act (статья 43 и 72) в сочетании с неизбежным усилением национальных требований на базе ГОСТ Р ИСО/МЭК 42001-2024 формируют единый, математически строгий регуляторный контур. Он диктует правила игры для любых серьезных разработок в области ИИ.15

Дедлайны августа 2026 и 2027 годов зафиксированы окончательно.7 Для российских B2B-интеграторов, обслуживающих высокорисковые отрасли, а также для корпораций, ориентированных на экспорт программного обеспечения или включенных в глобальные цифровые цепочки поставок, стратегический план должен базироваться на принципах инженерии надежности и формальной верификации:

- Алгоритмическая инвентаризация и стратификация: Необходимо инициировать исчерпывающую ревизию всех эксплуатируемых моделей. Каждая система должна быть категоризирована через призму метрик риска EU AI Act (Статья 6 и Приложения I, III).37 Системы, подпадающие под статус «высокорисковых», требуют немедленного проектирования архитектуры оценки соответствия.

- Развертывание организационного фундамента (ISO 42001): Внедрение стандарта ГОСТ Р ИСО/МЭК 42001-2024 (эквивалента ISO/IEC 42001:2023) в существующий контур корпоративного управления.41 Активация 39 инженерных контролей Приложения А с привязкой к конкретным ответственным лицам и бизнес-процессам.

- Переход к продуктовому комплаенсу (prEN 18286): Организационных процессов недостаточно для вывода высокорискового ИИ в эксплуатацию.26 Требуется проектирование Системы управления качеством (QMS) в строгом соответствии с 13 требованиями Статьи 17 EU AI Act.60 Стандарт prEN 18286 должен стать настольной книгой технического директора для подготовки к аудиту Нотифицированных органов (Notified Bodies).30

- Сквозная автоматизация доказательной базы: Отказ от ручного документирования в пользу «комплаенса как кода» (compliance-as-code).78 Внедрение непрерывного пострыночного мониторинга (Статья 72) на базе темпоральной логики (LTL) и детерминированного контроля состояний (FSM).

Формальная верификация и стандартизированный комплаенс перестали быть академическими концепциями. Сегодня это жесткий квалификационный барьер, определяющий выживание продукта на рынке. Создание внутренней архитектуры сертификации, способной зеркально отвечать на внешние аудиты — это не только вопрос юридической безопасности (что будет детально рассмотрено в Longread №6), но и фундамент технологического суверенитета, анализу которого посвящен пятый материал данного цикла (Longread №5). Интеграторы, способные перевести юридические требования в машиночитаемые контроли, получат стратегическую монополию в эпоху алгоритмической подотчетности.

Источники

Digital Omnibus on AI Trilogue Stalls Ahead of the AI Act Deadline — Bird & Bird, дата последнего обращения: мая 5, 2026, https://www.twobirds.com/en/insights/2026/germany/digital-omnibus-on-ai-trilogue-stalls-ahead-of-the-ai-act-deadline

Brussels AI Act talks collapse — but the August 2026 deadline holds, дата последнего обращения: мая 5, 2026, https://ppc.land/brussels-ai-act-talks-collapse-but-the-august-2026-deadline-holds/

EU and Parliament fail to agree on AI Act changes after 12 hours of talks, pushing deal to next month — TNW, дата последнего обращения: мая 5, 2026, https://thenextweb.com/news/eu-ai-act-omnibus-deal-fails-april-2026-talks

The Digital AI Omnibus: Proposed deferral of high risk AI obligations under the AI Act, дата последнего обращения: мая 5, 2026, https://knowledge.dlapiper.com/dlapiperknowledge/globalemploymentlatestdevelopments/2026/The-Digital-AI-Omnibus-Proposed-deferral-of-high-risk-AI-obligations-under-the-AI-Act

дата последнего обращения: мая 5, 2026, https://www.ropesgray.com/en/insights/viewpoints/102mquz/ai-omnibus-trilogue-underwaywhat-to-expect-as-negotiations-progress#:~:text=Both%20the%20Council%20and%20Parliament,regulated%20products%20under%20Annex%20I.

AI Act Omnibus: What just happened and what comes next? — IAPP, дата последнего обращения: мая 5, 2026, https://iapp.org/news/a/ai-act-omnibus-what-just-happened-and-what-comes-next

Current State of the EU AI Act — VDE, дата последнего обращения: мая 5, 2026, https://www.vde.com/topics-en/artificial-intelligence/blog/status-quo-ai-act

AI Act | Shaping Europe’s digital future — European Union, дата последнего обращения: мая 5, 2026, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

дата последнего обращения: мая 5, 2026, https://www.hklaw.com/en/insights/publications/2026/04/us-companies-face-eu-ai-acts-possible-august-2026-compliance-deadline#:~:text=The%20EU%20AI%20Act%20has,prior%20to%20August%202%2C%202026.

Implementation Timeline | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/implementation-timeline/

Timeline for the Implementation of the EU AI Act | AI Act Service Desk, дата последнего обращения: мая 5, 2026, https://ai-act-service-desk.ec.europa.eu/en/ai-act/timeline/timeline-implementation-eu-ai-act

17-promt-tema-3-iso-42001-eu-ai-act.md

How the Brussels Effect Hinders Innovation in the Global South, дата последнего обращения: мая 5, 2026, https://datainnovation.org/2026/01/how-brussels-effect-hinders-innovation-in-global-south/

The EU’s AI Power Play: Between Deregulation and Innovation, дата последнего обращения: мая 5, 2026, https://carnegieendowment.org/russia-eurasia/research/2025/05/the-eus-ai-power-play-between-deregulation-and-innovation

EU AI Act post-market monitoring guide April 2026 — Openlayer, дата последнего обращения: мая 5, 2026, https://www.openlayer.com/blog/post/eu-ai-act-post-market-monitoring-requirements

ISO 42001 and the EU AI Act: What Actually Maps and What Doesn’t — Truvo Cyber, дата последнего обращения: мая 5, 2026, https://truvocyber.com/blog/iso-42001-and-eu-ai-act

Global AI Governance Comparison 2026: EU AI Act vs NIST AI RMF vs ISO/IEC 42001, дата последнего обращения: мая 5, 2026, https://gaicc.org/blog/ai-governance-comparison-eu-ai-act-nist-iso-42001/

Global standards for AI governance: EU AI Act, ISO 42001 and NIST compared — Modulos AI, дата последнего обращения: мая 5, 2026, https://www.modulos.ai/blog/global-standards-for-ai-governance/

EU AI Act vs NIST AI RMF vs ISO/IEC 42001: A Plain English Comparison — EC-Council, дата последнего обращения: мая 5, 2026, https://www.eccouncil.org/cybersecurity-exchange/responsible-ai-governance/eu-ai-act-nist-ai-rmf-and-iso-iec-42001-a-plain-english-comparison/

AI Governance Frameworks: NIST AI RMF, EU AI Act, and ISO 42001 Compared — Trustible, дата последнего обращения: мая 5, 2026, https://trustible.ai/post/ai-governance-frameworks-compared/

AI lifecycle risk management: ISO/IEC 42001:2023 for AI governance | AWS Security Blog, дата последнего обращения: мая 5, 2026, https://aws.amazon.com/blogs/security/ai-lifecycle-risk-management-iso-iec-420012023-for-ai-governance/

What is ISO/IEC 42001:2023? — ControlCase, дата последнего обращения: мая 5, 2026, https://www.controlcase.com/what-is-iso-iec-42001-2023/

ISO/IEC 42001:2023 Artificial Intelligence Management System Standards — Microsoft Learn, дата последнего обращения: мая 5, 2026, https://learn.microsoft.com/en-us/compliance/regulatory/offering-iso-42001

ISO/IEC 42001 and EU AI Act: A Practical Pairing for AI Governance — ISACA, дата последнего обращения: мая 5, 2026, https://www.isaca.org/resources/news-and-trends/industry-news/2025/isoiec-42001-and-eu-ai-act-a-practical-pairing-for-ai-governance

ISO 42001 paving the way for ethical AI | EY — US, дата последнего обращения: мая 5, 2026, https://www.ey.com/en_us/insights/ai/iso-42001-paving-the-way-for-ethical-ai

Your ISO 42001 Certification Won’t Make Your AI System Compliant — Modulos AI, дата последнего обращения: мая 5, 2026, https://www.modulos.ai/blog/-your-iso-42001-certification-won-t-make-your-ai-system-compliant/

ISO 42001 Controls Explained: Annex A — Hicomply, дата последнего обращения: мая 5, 2026, https://www.hicomply.com/hub/annex-a-controls

Use ISO 42001 & NIST AI RMF to Help with the EU AI Act | CSA — Cloud Security Alliance, дата последнего обращения: мая 5, 2026, https://cloudsecurityalliance.org/blog/2025/01/29/how-can-iso-iec-42001-nist-ai-rmf-help-comply-with-the-eu-ai-act

EU AI Act vs ISO 42001: 7 differences that affect your compliance approach — VerifyWise, дата последнего обращения: мая 5, 2026, https://verifywise.ai/blog/eu-ai-act-vs-iso-42001-similarities-and-differences

Conformity assessment of high‑risk AI systems under the EU AI Act: what providers need to know — VDE, дата последнего обращения: мая 5, 2026, https://www.vde.com/topics-en/artificial-intelligence/blog/conformity-assessment-high-risk-ai

High-level summary of the AI Act | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/high-level-summary/

EU Artificial Intelligence Act | Up-to-date developments and analyses of the EU AI Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/

The AI Act Risk Management System — ICT Institute, дата последнего обращения: мая 5, 2026, https://ictinstitute.nl/the-ai-act-risk-management-system/

The EU’s Digital Omnibus is heading in the wrong direction — Jacques Delors Centre, дата последнего обращения: мая 5, 2026, https://www.delorscentre.eu/en/publications/detail/publication/the-eus-digital-and-ai-omnibus

Mapping the Regulatory Learning Space for the EU AI Act — arXiv, дата последнего обращения: мая 5, 2026, https://arxiv.org/html/2503.05787v2

Article 17: Quality Management System | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/article/17/

EU AI Act & ISO 42001: Compatibility & implementation guidelines | Vanta, дата последнего обращения: мая 5, 2026, https://www.vanta.com/collection/iso-42001/iso-42001-and-eu-ai-act

Conformity Assessments under the EU AI Act: A step-by step guide — The Future of Privacy Forum, дата последнего обращения: мая 5, 2026, https://fpf.org/wp-content/uploads/2025/04/OT-comformity-assessment-under-the-eu-ai-act-WP-1.pdf

AI Compliance Guide 2026: Global Regulations | Modulos, дата последнего обращения: мая 5, 2026, https://www.modulos.ai/ai-compliance-guide/

U.S. Companies Face EU AI Act’s Possible August 2026 Compliance Deadline | Insights, дата последнего обращения: мая 5, 2026, https://www.hklaw.com/en/insights/publications/2026/04/us-companies-face-eu-ai-acts-possible-august-2026-compliance-deadline

EU AI Act + ISO 42001 Mapping Guide — Glocert International, дата последнего обращения: мая 5, 2026, https://www.glocertinternational.com/resources/guides/eu-ai-act-mapping-iso-42001/

Understanding ISO 42001 and Demonstrating Compliance — ISMS.online, дата последнего обращения: мая 5, 2026, https://www.isms.online/iso-42001/

ГОСТ Р ИСО/МЭК 42001-2024. Искусственный интеллект. Система менеджмента, дата последнего обращения: мая 5, 2026, https://internet-law.ru/gosts/gost/83893/

ГОСТ Р ИСО/МЭК 42001-2024 Искусственный интеллект. Система менеджмента — docs.cntd.ru, дата последнего обращения: мая 5, 2026, https://docs.cntd.ru/document/1310068313

Росстандарт: Опубликован стандарт ГОСТ Р ИСО/МЭК 42001-2024 «Искусственный интеллект. Система менеджмента, дата последнего обращения: мая 5, 2026, http://rusrim.blogspot.com/2025/01/42001-2024.html

ГОСТ для искусственного интеллекта: что изменится в бизнесе с 2026 года, дата последнего обращения: мая 5, 2026, https://berger-group.ru/blog/gost-dlya-iskusstvennogo-intellekta-chto-izmenitsya-v-biznese-s-2026-goda/

ISO/IEC 42001 Certification Requirements Explained — Schellman, дата последнего обращения: мая 5, 2026, https://www.schellman.com/blog/iso-certifications/what-are-iso-42001-requirements

Сертификация ISO 42001 — система менеджмента ИИ — ООО «Астелс», дата последнего обращения: мая 5, 2026, https://sertifikat.bz/iso_mek_42001_sertifikaciya_sistemy_menedzhmenta_ii

ISO/IEC 42001 Annex A Controls Explained A Practical Guide — SureCloud, дата последнего обращения: мая 5, 2026, https://www.surecloud.com/resource-hub/iso-42001-annex-a-controls

Mapping Table: ISO 42001 Annex A — NIS 2 Risk Management — EU AI Act — Digital Reforming is an, дата последнего обращения: мая 5, 2026, https://digitalreforming.com/wp-content/uploads/2025/09/Mapping-Table_ISO42001-NIS2-AIAct_publishingVersion.pdf

ISO/IEC 42001: AI Security & Management Guide — BD Emerson, дата последнего обращения: мая 5, 2026, https://www.bdemerson.com/article/iso-iec-42001-ai-security-implementation-guide

Third-Party Risk Management Under ISO 42001 and the EU AI Act — A-LIGN, дата последнего обращения: мая 5, 2026, https://www.a-lign.com/articles/third-party-risk-management-iso-42001-eu-ai-act

ISO 42001 Certification Cost Breakdown: What Enterprise AI Teams Pay in 2026, дата последнего обращения: мая 5, 2026, https://elevateconsult.com/insights/iso-42001-certification-cost-breakdown-what-enterprise-ai-teams-pay-in-2026/

ISO 42001 Certification Cost Calculator 2026 — CertBetter, дата последнего обращения: мая 5, 2026, https://certbetter.com/blog/iso-42001-certification-cost-calculator

ISO 42001 for Startups: What It Covers, What It Costs, and Whether You Need It | Workstreet, дата последнего обращения: мая 5, 2026, https://www.workstreet.com/blog/iso-42001-for-startups

ISO/IEC 42006:2025 — Information technology — Artificial intelligence — ANSI Webstore, дата последнего обращения: мая 5, 2026, https://webstore.ansi.org/standards/iso/isoiec420062025

ISO/IEC 42006:2025, дата последнего обращения: мая 5, 2026, https://webstore.iec.ch/en/publication/108460

BS ISO/IEC 42006:2025 | 31 Jul 2025 — BSI Knowledge, дата последнего обращения: мая 5, 2026, https://knowledge.bsigroup.com/products/information-technology-artificial-intelligence-requirements-for-bodies-providing-audit-and-certification-of-artificial-intelligence-management-systems

Understanding the Average Cost of ISO Certification Factors — ISO 27001 | IT Forensics, дата последнего обращения: мая 5, 2026, https://acato.co.uk/understanding-the-average-cost-of-iso-certification-factors/

The first draft AI Act standard for public consultation: what prEN …, дата последнего обращения: мая 5, 2026, https://cms.law/en/gbr/legal-updates/the-first-draft-ai-act-standard-for-public-consultation-what-pren-18286-quality-management-system-for-eu-ai-act-regulatory-purposes-signals-for

Article 72: Post-Market Monitoring by Providers and Post-Market Monitoring Plan for High-Risk AI Systems | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/article/72/

Is ISO 42001 Enough? Why High-Risk AI Remains Exposed Under the EU AI Act — ISMS.online, дата последнего обращения: мая 5, 2026, https://www.isms.online/frameworks/iso-42001/iso-42001-risk-management-eu-ai-act-high-risk-systems/

Annex IV: Technical Documentation Referred to in Article 11(1) | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/annex/4/

AI Act Service Desk — Annex IV — European Union, дата последнего обращения: мая 5, 2026, https://ai-act-service-desk.ec.europa.eu/en/ai-act/annex-4

The role of harmonised standards as tools for AI act compliance — DLA Piper, дата последнего обращения: мая 5, 2026, https://www.dlapiper.com/insights/publications/2024/01/the-role-of-harmonised-standards-as-tools-for-ai-act-compliance

Artificial Intelligence — CEN-CENELEC, дата последнего обращения: мая 5, 2026, https://www.cencenelec.eu/areas-of-work/cen-cenelec-topics/artificial-intelligence/

Understanding the standardisation of the AI Act | Shaping Europe’s digital future, дата последнего обращения: мая 5, 2026, https://digital-strategy.ec.europa.eu/en/faqs/understanding-standardisation-ai-act

Update on CEN and CENELEC’s Decision to Accelerate the Development of Standards for Artificial Intelligence, дата последнего обращения: мая 5, 2026, https://www.cencenelec.eu/news-events/news/2025/brief-news/2025-10-23-ai-standardization/

Standardisation of the AI Act | Shaping Europe’s digital future — European Union, дата последнего обращения: мая 5, 2026, https://digital-strategy.ec.europa.eu/en/policies/ai-act-standardisation

prEN 18286: Early Breakdown of the EU AI Act Standard — Lumenova AI, дата последнего обращения: мая 5, 2026, https://www.lumenova.ai/blog/pren-18286-eu-ai-act-standard/

ISO/IEC 42001 vs prEN 18286: Understanding the Differences for EU AI Act Compliance, дата последнего обращения: мая 5, 2026, https://aiassurance.institute/articles/iso-42001-and-pren-18286-differ.html

CEN-CENELEC JTC21 AI Standards: Complete Detailed Overview, дата последнего обращения: мая 5, 2026, https://jtc21.eu/wp-content/uploads/2025/06/CEN-CENELEC-JTC21-AI-Standards-Complete-Detailed-Overview.pdf

work program timeline — Airise, дата последнего обращения: мая 5, 2026, https://airise.eu/ecosystem/standards-training/work-program-timeline

The first draft AI Act standard for public consultation: what prEN 18286 (Quality Management System for EU AI Act regulatory purposes) signals for providers, users and regulators — Cms.law, дата последнего обращения: мая 5, 2026, https://cms.law/en/chl/legal-updates/the-first-draft-ai-act-standard-for-public-consultation-what-pren-18286-quality-management-system-for-eu-ai-act-regulatory-purposes-signals-for

NIS 2, DORA, and EU AI Act: Where European Compliance Rules Collide and Overlap — ISMS.online, дата последнего обращения: мая 5, 2026, https://www.isms.online/nis-2/vs/dora-vs-eu-ai-act/

The Compliance Triple Threat: Mastering the Overlap Between DORA, NIS2, and the EU AI Act — Enactia, дата последнего обращения: мая 5, 2026, https://enactia.com/dora-nis2-eu-ai-act-overlap-strategy/

NIS2 vs. DORA: differences and common misconceptions — activeMind.legal, дата последнего обращения: мая 5, 2026, https://www.activemind.legal/guides/nis2-dora/

Making AI Compliance Evidence Machine-Readable — arXiv, дата последнего обращения: мая 5, 2026, https://arxiv.org/html/2604.13767v1

Article 6: Classification Rules for High-Risk AI Systems | EU Artificial Intelligence Act, дата последнего обращения: мая 5, 2026, https://artificialintelligenceact.eu/article/6/

EU AI Act: Quality Management System — VDE, дата последнего обращения: мая 5, 2026, https://www.vde.com/topics-en/artificial-intelligence/blog/eu-ai-act—quality-management-system